Historia komputerów to fascynująca podróż, która rozpoczęła się na długo przed erą cyfrową, od prostych narzędzi liczących po skomplikowane maszyny, które dziś nosimy w kieszeniach. W tym artykule zabierzemy Was w podróż przez kluczowe momenty tej ewolucji, odpowiadając na pytania, kto, kiedy, jak i dlaczego stworzył urządzenia, które zrewolucjonizowały nasz świat.

Ewolucja komputerów: od mechanicznych maszyn do cyfrowej rewolucji

- Historia komputera to długa droga od starożytnych liczydel, przez mechaniczne kalkulatory Pascala i wizję maszyny analitycznej Babbage'a.

- Kluczowe postacie to Charles Babbage (ojciec komputera), Ada Lovelace (pierwsza programistka), Alan Turing (maszyna Turinga) oraz John von Neumann (architektura komputerów).

- Przełomowe wynalazki to m.in. Z3 Konrada Zusego, gigantyczny ENIAC, wynalezienie tranzystora, układu scalonego i mikroprocesora.

- Komputery ewoluowały przez cztery generacje: od lamp elektronowych, przez tranzystory, układy scalone, aż po mikroprocesory, prowadząc do rewolucji PC.

- Polska również miała swój wkład w rozwój informatyki, tworząc pionierskie konstrukcje takie jak XYZ, Odra czy innowacyjny K-202 Jacka Karpińskiego.

- Współczesność to era mobilna, a przyszłość to rozwój sztucznej inteligencji i obliczeń kwantowych.

Od liczydeł do mechanicznych marzeń: jak narodziła się idea komputera

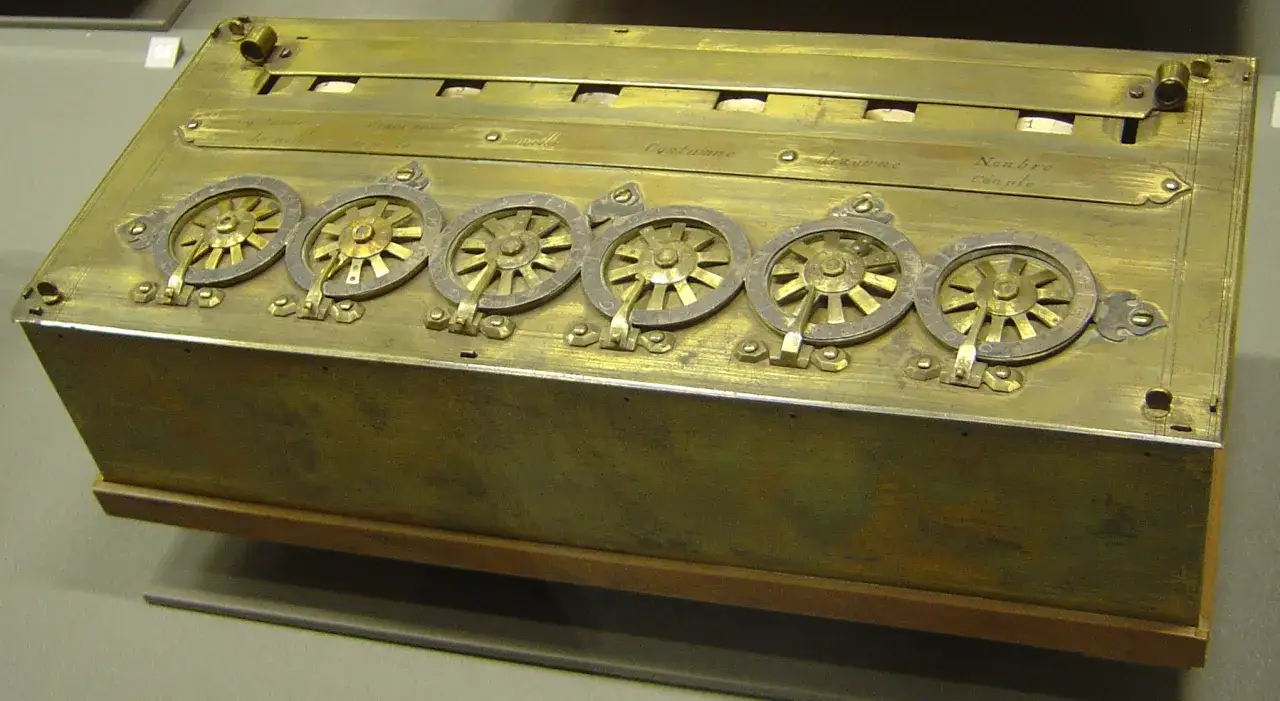

Starożytni ludzie, potrzebując sposobu na ułatwienie sobie skomplikowanych obliczeń, sięgali po proste narzędzia. Jednym z najstarszych i najbardziej znanych jest abakus, który w różnych formach towarzyszył ludzkości przez tysiąclecia. Choć nie można go nazwać komputerem w dzisiejszym rozumieniu, był to pierwszy krok w kierunku automatyzacji procesów liczenia. Prawdziwy przełom nastąpił jednak dopiero w XVII wieku, wraz z narodzinami pierwszych mechanicznych kalkulatorów. Blaise Pascal, francuski matematyk i filozof, w 1642 roku skonstruował maszynę nazwaną Pascaliną. Było to urządzenie zdolne do wykonywania podstawowych operacji arytmetycznych, takich jak dodawanie i odejmowanie, za pomocą systemu kół zębatych. Choć ograniczona w swoich możliwościach, Pascalina zapoczątkowała ideę tworzenia maszyn, które mogą samodzielnie przetwarzać liczby, otwierając drzwi do dalszych innowacji.

Starożytni prekursorzy: Czy abakus był pierwszym narzędziem obliczeniowym?

Abakus, choć prymitywny w porównaniu do dzisiejszych technologii, stanowił fundamentalne narzędzie wspierające ludzkie zdolności arytmetyczne przez tysiąclecia. Był to pierwszy krok w kierunku mechanizacji obliczeń, który położył podwaliny pod przyszłe wynalazki. Pascalina, stworzona przez Blaise'a Pascala, była kolejnym kamieniem milowym pierwszym w pełni mechanicznym kalkulatorem, który demonstrował potencjał maszyn w wykonywaniu złożonych działań matematycznych.

Charles Babbage i jego maszyna analityczna: Dlaczego projekt "ojca komputerów" wyprzedził swoją epokę?

Za „ojca komputera” często uważa się Charlesa Babbage’a, który w 1837 roku przedstawił koncepcję maszyny analitycznej mechanicznego komputera programowalnego. Jego wizja była niezwykle ambitna i wyprzedzała swoje czasy o ponad sto lat. Maszyna analityczna miała posiadać jednostkę arytmetyczno-logiczną (nazywaną "młynem"), pamięć (nazywaną "magazynem") oraz system wprowadzania danych i instrukcji za pomocą kart perforowanych. To właśnie koncepcja programowalności, czyli możliwość wykonywania różnych zadań w zależności od wprowadzonego programu, stanowiła kluczowy element jego projektu. Niestety, ze względu na ograniczenia technologiczne i finansowe epoki, maszyna analityczna nigdy nie została w pełni zbudowana za życia Babbage'a, pozostając jedynie genialnym projektem na papierze.

Za „ojca komputera” często uważa się Charlesa Babbage’a, który w 1837 roku przedstawił koncepcję maszyny analitycznej mechanicznego komputera programowalnego.

Kim była Ada Lovelace? Poznaj historię pierwszej programistki

Współpracowniczką Charlesa Babbage'a była Ada Lovelace, córka słynnego poety lorda Byrona. Jej wkład w rozwój idei komputera jest nieoceniony. Lovelace nie tylko rozumiała wizję Babbage'a, ale także potrafiła ją rozwijać, tworząc algorytmy przeznaczone do wykonania na maszynie analitycznej. W swoich notatkach opisała sposób, w jaki maszyna mogłaby obliczyć liczby Bernoulliego, co jest powszechnie uznawane za pierwszy w historii program komputerowy. Z tego powodu Ada Lovelace jest uważana za pierwszą programistkę na świecie. Jej prace dowiodły, że maszyny mogą być wykorzystywane nie tylko do prostych obliczeń, ale także do bardziej złożonych zadań, takich jak przetwarzanie symboli czy tworzenie muzyki.

Wiek pary i elektryczności: przełom, który zapoczątkował rewolucję komputerową

Druga połowa XIX i początek XX wieku to okres dynamicznego rozwoju technologii, który stopniowo przybliżał ludzkość do stworzenia prawdziwych komputerów. Teoretyczne koncepcje zaczęły nabierać realnych kształtów, a II Wojna Światowa, paradoksalnie, stała się potężnym motorem napędowym dla rozwoju maszyn obliczeniowych, które miały kluczowe znaczenie dla działań militarnych.

Maszyna Turinga: Jak teoretyczny model z 1936 roku zdefiniował współczesną informatykę?

W 1936 roku brytyjski matematyk Alan Turing opublikował przełomową pracę, w której przedstawił teoretyczny model maszyny uniwersalnej, znanej dziś jako maszyna Turinga. Był to abstrakcyjny koncept, który zdefiniował pojęcie algorytmu i obliczalności, stając się fundamentem dla całej dziedziny informatyki. Turing wykazał, że taka maszyna jest w stanie symulować działanie dowolnego innego automatu obliczeniowego. Jego praca miała ogromne znaczenie praktyczne podczas II Wojny Światowej, gdy w Bletchley Park kierował zespołem łamiącym niemiecki kod Enigmy. Sukcesy w deszyfracji przyczyniły się do zwycięstwa aliantów, a doświadczenia zdobyte podczas wojny utorowały drogę dla rozwoju pierwszych elektronicznych komputerów.

Konrad Zuse i jego Z3: Pierwszy programowalny komputer w historii

Równolegle z pracami Turinga, w Niemczech Konrad Zuse tworzył swoje pionierskie konstrukcje. W 1941 roku uruchomił maszynę Z3, która jest uznawana za pierwszy w pełni automatyczny, programowalny komputer cyfrowy na świecie. Z3, zbudowana w oparciu o przekaźniki elektromechaniczne, potrafiła wykonywać złożone obliczenia, a jej programowanie odbywało się za pomocą taśmy perforowanej. Choć Z3 nie przetrwała wojny, jej koncepcja stanowiła ważny krok w kierunku budowy nowoczesnych maszyn obliczeniowych i jest często klasyfikowana jako przedstawiciel tzw. "Generacji 0" komputerów.

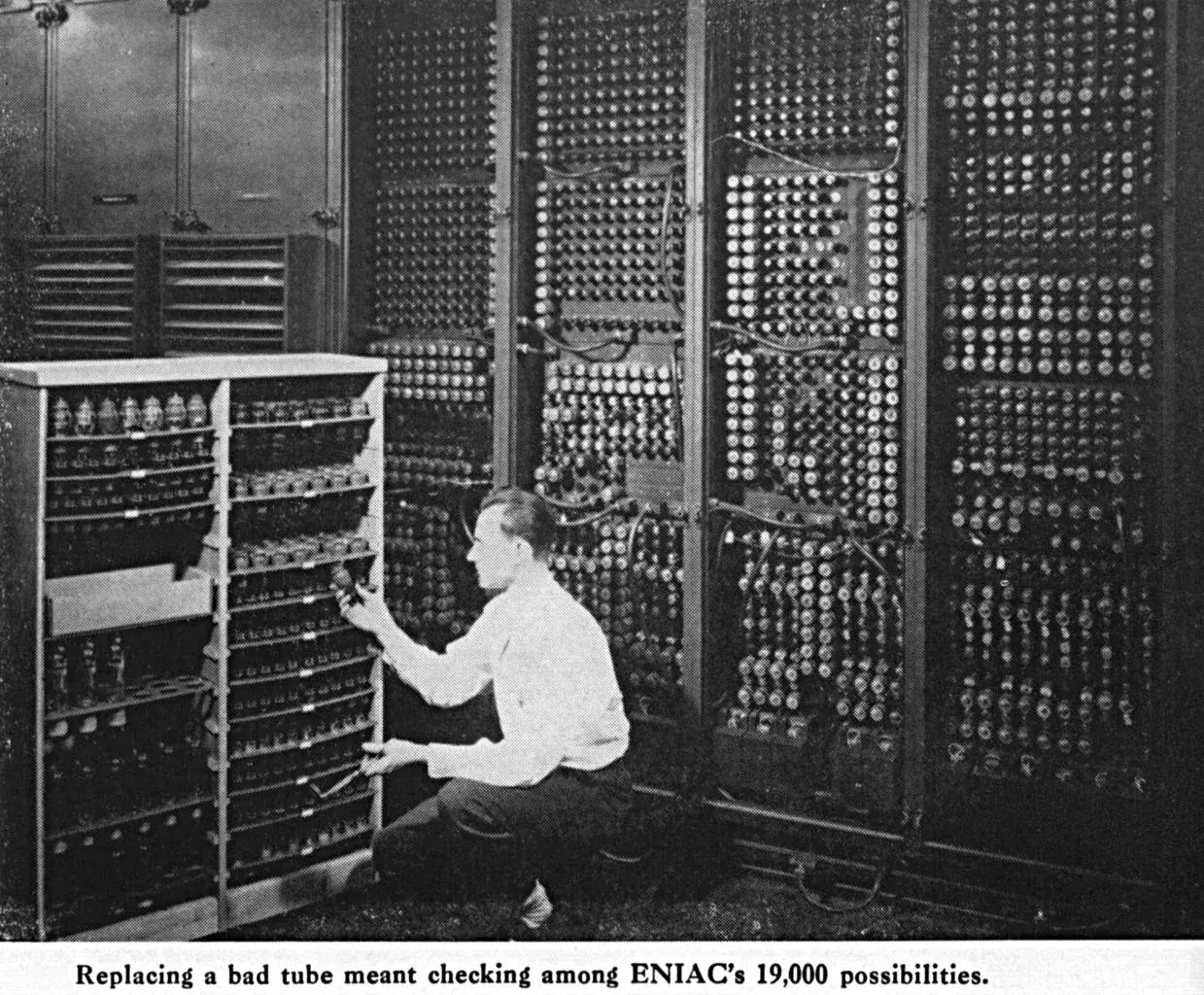

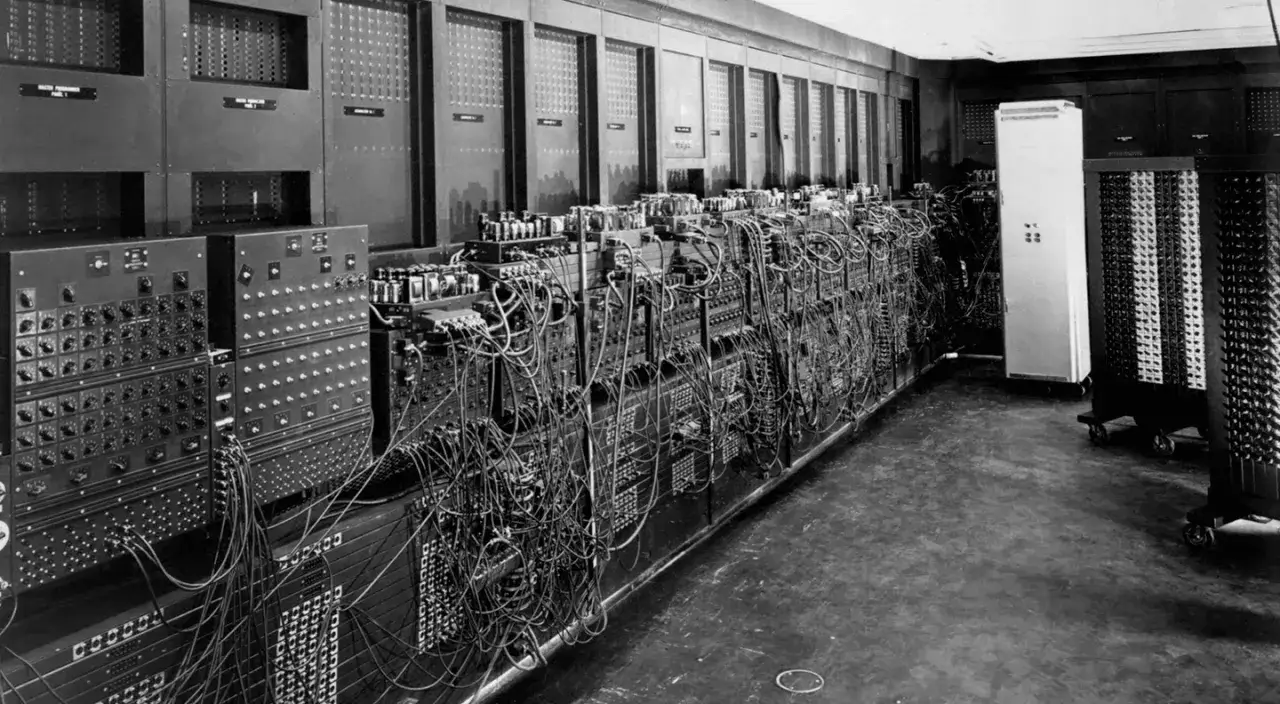

ENIAC 30-tonowy gigant, który odmienił oblicze II wojny światowej

Symbolem pierwszej generacji komputerów, opartych na lampach elektronowych, jest ENIAC (Electronic Numerical Integrator and Computer), uruchomiony w 1945 roku. Stworzony przez Johna P. Eckerta i Johna W. Mauchly'ego na potrzeby amerykańskiej armii, ENIAC był monumentalną maszyną. Zajmował powierzchnię 167 metrów kwadratowych, ważył 27 ton i zużywał ogromne ilości energii elektrycznej. Jego głównym zadaniem było wykonywanie skomplikowanych obliczeń balistycznych, które były kluczowe dla działań wojennych. Pomimo swoich rozmiarów i problemów z niezawodnością, ENIAC był powszechnie uznawany za pierwszy elektroniczny komputer ogólnego przeznaczenia, zdolny do wykonywania szerokiego zakresu zadań obliczeniowych.

Architektura von Neumanna: Dlaczego ten koncept do dziś jest fundamentem naszych komputerów?

W 1945 roku, niedługo po uruchomieniu ENIACa, amerykański matematyk i fizyk John von Neumann przedstawił koncepcję, która zrewolucjonizowała sposób projektowania komputerów. Jego architektura zakładała wspólne przechowywanie zarówno danych, jak i programu instrukcji w tej samej pamięci operacyjnej. To fundamentalne założenie, znane jako architektura von Neumanna, pozwoliło na znacznie większą elastyczność i efektywność maszyn. Dzięki niej komputery mogły łatwiej przetwarzać różne typy danych i programów, bez konieczności fizycznej przebudowy sprzętu. Koncepcja ta stała się fundamentem dla budowy praktycznie wszystkich współczesnych komputerów, od superkomputerów po smartfony.

Cztery generacje, które ukształtowały świat: miniaturyzacja i rosnąca moc

Historia rozwoju komputerów to nieustanny proces miniaturyzacji i wzrostu mocy obliczeniowej. Ten pęd ku coraz mniejszym, szybszym i bardziej wydajnym maszynom można podzielić na cztery główne generacje, z których każda przynosiła ze sobą rewolucyjne zmiany w technologii.

Generacja I: Królestwo zawodnych lamp elektronowych

Pierwsza generacja komputerów, obejmująca lata 1946-1958, zdominowana była przez użycie lamp elektronowych jako podstawowych elementów wykonawczych. Maszyny z tego okresu, takie jak wspomniany ENIAC, były ogromne, zużywały mnóstwo energii i były podatne na awarie. Lampy elektronowe, choć pozwalały na realizację podstawowych funkcji obliczeniowych, były zawodne, szybko się przegrzewały i miały ograniczoną żywotność. Praca z nimi wymagała dużej wiedzy technicznej, a programowanie było procesem niezwykle żmudnym i czasochłonnym.

Generacja II: Jak wynalezienie tranzystora zmieściło komputer w jednym pokoju?

Prawdziwą rewolucję w świecie komputerów przyniosło wynalezienie tranzystora w 1947 roku w Bell Laboratories. Tranzystory, które zastąpiły nieporęczne i zawodne lampy elektronowe, były znacznie mniejsze, zużywały mniej energii i były o wiele bardziej niezawodne. Komputery drugiej generacji (1959-1964) były dzięki nim mniejsze, szybsze i tańsze w eksploatacji. Nadal były to jednak maszyny zajmujące całe pomieszczenia, dostępne głównie dla dużych instytucji i korporacji.

Generacja III: Układ scalony, czyli rewolucja na płytce krzemowej

Kolejnym przełomowym momentem było wynalezienie układu scalonego (IC - Integrated Circuit) w 1958 roku. Układ scalony umożliwił umieszczenie setek, a później tysięcy tranzystorów, rezystorów i innych elementów elektronicznych na jednej, niewielkiej płytce krzemowej. Komputery trzeciej generacji (1965-1974) stały się dzięki temu jeszcze mniejsze, szybsze i tańsze. Pojawiły się pierwsze minikomputery, które zaczęły być dostępne dla mniejszych firm i uniwersytetów.

Generacja IV: Mikroprocesor i eksplozja komputerów osobistych (PC)

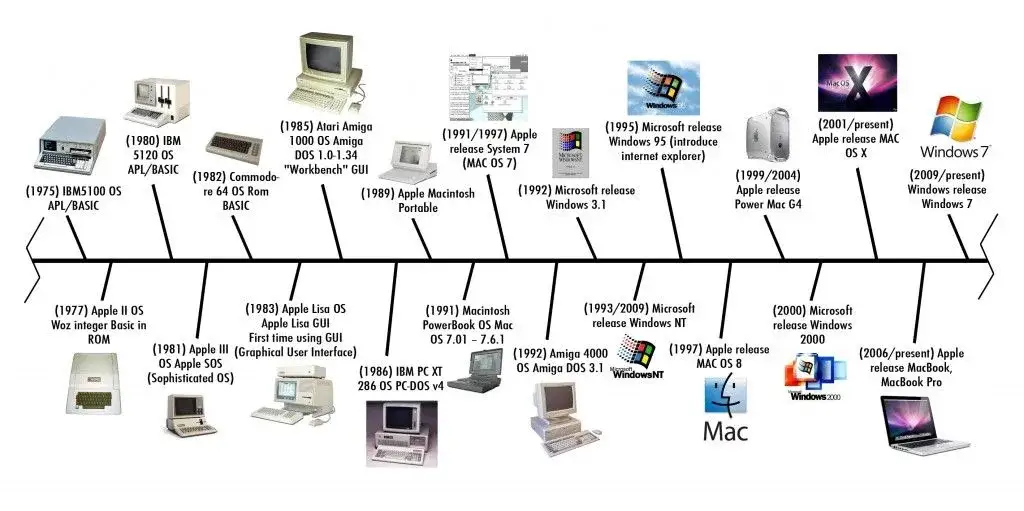

Początek lat 70. XX wieku przyniósł wynalazek, który na zawsze zmienił oblicze technologii mikroprocesor. W 1971 roku firma Intel zaprezentowała Intel 4004, pierwszy jednoczipowy mikroprocesor, który zawierał w sobie wszystkie kluczowe funkcje procesora. To właśnie mikroprocesory umożliwiły masową produkcję komputerów osobistych (PC), które zaczęły trafiać do domów i biur na całym świecie. Komputery czwartej generacji (od 1975 roku) charakteryzują się ogromną mocą obliczeniową w stosunku do swoich rozmiarów i ceny, co doprowadziło do cyfrowej rewolucji, której jesteśmy świadkami do dziś.

Rewolucja PC: jak komputer trafił z laboratoriów pod strzechy

Wynalezienie mikroprocesora otworzyło drzwi do zupełnie nowej ery ery komputerów osobistych. Technologia, która wcześniej zarezerwowana była dla laboratoriów badawczych i wielkich korporacji, zaczęła stawać się dostępna dla przeciętnego użytkownika, co doprowadziło do prawdziwej rewolucji społecznej i technologicznej.

Altair 8800: Komputer dla hobbystów, który rozpalił iskrę w garażu Billa Gatesa

Jednym z pierwszych komputerów osobistych, który wzbudził ogromne zainteresowanie wśród hobbystów i entuzjastów technologii, był Altair 8800, wprowadzony na rynek w 1975 roku. Choć był to komputer do samodzielnego montażu, z ograniczonymi możliwościami i wymagający od użytkownika sporej wiedzy technicznej, stał się on katalizatorem dla wielu młodych inżynierów i programistów. Wśród nich byli Bill Gates i Paul Allen, którzy stworzyli dla Altaira interpreter języka BASIC, co było ich pierwszym krokiem do założenia firmy Microsoft i zrewolucjonizowania rynku oprogramowania.

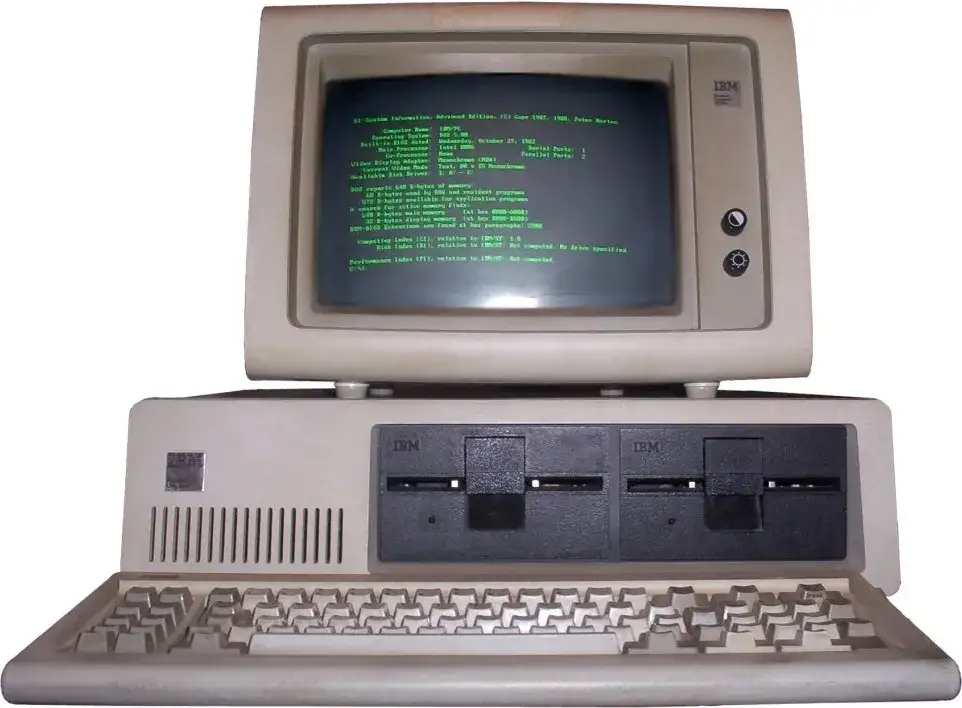

Apple vs. IBM: Historia rywalizacji, która zdefiniowała rynek komputerów osobistych

Rok 1976 przyniósł założenie firmy Apple przez Steve'a Jobsa i Steve'a Wozniaka, którzy wkrótce zaprezentowali swój pierwszy komputer Apple I, a następnie znacznie bardziej popularny Apple II. Były to maszyny, które w znacznym stopniu ułatwiły korzystanie z komputera dzięki bardziej przyjaznemu interfejsowi. Prawdziwy przełom nastąpił jednak w 1981 roku, gdy gigant branży komputerowej, IBM, wprowadził na rynek swój własny komputer osobisty IBM PC. Architektura IBM PC stała się standardem, który zdominował rynek i zapoczątkował erę masowej komputeryzacji. Rywalizacja między Apple a IBM, a później z innymi producentami, napędzała innowacje i sprawiła, że komputery stały się integralną częścią naszego życia.

Od MS-DOS do Windows: Jak graficzny interfejs zmienił sposób, w jaki korzystamy z komputerów?

Początkowo komputery osobiste były obsługiwane za pomocą tekstowych interfejsów, takich jak MS-DOS. Wymagało to od użytkowników zapamiętywania skomplikowanych komend i poleceń. Prawdziwą rewolucję w interakcji człowiek-komputer przyniosło wprowadzenie graficznych interfejsów użytkownika (GUI - Graphical User Interface). Systemy takie jak Macintosh firmy Apple, a później Microsoft Windows, pozwoliły na intuicyjną obsługę komputera za pomocą ikon, okien i myszki. Ta zmiana sprawiła, że komputery stały się dostępne dla znacznie szerszego grona odbiorców, niezależnie od ich technicznej wiedzy.

Polski wkład w historię informatyki: mało znane fakty

Historia informatyki to nie tylko opowieść o amerykańskich i brytyjskich pionierach. Polska również ma swój znaczący, choć często niedoceniany, wkład w rozwój tej dziedziny. W czasach, gdy komputery były domeną nielicznych, polscy inżynierowie i naukowcy tworzyli innowacyjne konstrukcje, które dorównywały, a czasem nawet przewyższały, rozwiązania zagraniczne.

XYZ i Odra: Pionierskie konstrukcje zza żelaznej kurtyny

Pierwszym polskim komputerem cyfrowym był XYZ, uruchomiony w 1958 roku. Była to maszyna lampowa, która stanowiła ważny krok w rozwoju polskiej informatyki. W kolejnych latach, w latach 60. i 70., dużą popularność zdobyły komputery z rodziny Odra, produkowane przez zakłady Elwro we Wrocławiu. Komputery te, choć bazujące na technologii tamtych czasów, były solidnymi i wszechstronnymi maszynami, które znalazły zastosowanie w wielu polskich przedsiębiorstwach i instytucjach naukowych.

Jacek Karpiński i K-202: Historia komputera, który mógł zmienić wszystko

Jedną z najbardziej fascynujących postaci polskiej informatyki jest Jacek Karpiński. W 1970 roku, w zespole pod jego kierownictwem, powstał minikomputer K-202. Była to konstrukcja niezwykle innowacyjna jak na swoje czasy. K-202 wykorzystywał zaawansowane rozwiązania technologiczne, takie jak pamięć ferrytową i układy scalone, co pozwalało na osiągnięcie parametrów porównywalnych z najlepszymi zachodnimi minikomputerami. Niestety, ze względu na ówczesną sytuację polityczną i gospodarczą, K-202 nie doczekał się masowej produkcji, pozostając w historii jako symbol potencjału polskiej myśli technicznej, który mógł zmienić bieg rozwoju informatyki w Polsce i na świecie.

Co przyniesie przyszłość? Od sztucznej inteligencji po komputery kwantowe

Historia komputerów to opowieść o ciągłym postępie i nieustannym przekraczaniu granic możliwości. Dziś, gdy patrzymy na urządzenia, które nosimy w kieszeniach, trudno uwierzyć, jak daleko zaszliśmy od czasów wielkich, parowych maszyn. Ale rozwój technologii wcale nie zwalnia tempa wręcz przeciwnie, nabiera coraz większego rozpędu, otwierając przed nami nowe, fascynujące perspektywy.

Era mobilna: Jak smartfon w Twojej kieszeni stał się potężniejszy niż komputery NASA?

Dzisiejsze smartfony to prawdziwe cuda techniki. Urządzenia, które mieszczą się w dłoni, posiadają moc obliczeniową, która wielokrotnie przewyższa komputery, które NASA wykorzystywała do wysłania ludzi na Księżyc. Ta miniaturyzacja i wzrost mocy sprawiły, że technologia stała się wszechobecna. Mamy dostęp do informacji i komunikacji w każdej chwili i niemal w każdym miejscu na świecie. Era mobilna zrewolucjonizowała sposób, w jaki pracujemy, uczymy się, bawimy i nawiązujemy relacje z innymi.

AI i obliczenia kwantowe: Czy stoimy u progu kolejnej wielkiej rewolucji w informatyce?

Przyszłość informatyki rysuje się w barwach sztucznej inteligencji (AI) i obliczeń kwantowych. AI, dzięki algorytmom uczenia maszynowego, coraz lepiej radzi sobie z zadaniami, które do niedawna były domeną wyłącznie ludzkiego umysłu od rozpoznawania obrazów i mowy, po tworzenie złożonych strategii. Z kolei komputery kwantowe, wykorzystujące zasady mechaniki kwantowej, mają potencjał do rozwiązania problemów, które są obecnie nieosiągalne dla nawet najpotężniejszych superkomputerów. Choć wciąż są to technologie na wczesnym etapie rozwoju, ich potencjalny wpływ na naukę, medycynę, przemysł i nasze codzienne życie jest trudny do przecenienia. Stoimy u progu kolejnej wielkiej rewolucji, która może zmienić świat w sposób, jakiego jeszcze nie doświadczyliśmy.

Przeczytaj również: Trybunał Konstytucyjny: Kiedy powstał i jak zmieniała się jego rola?

Twoja podróż przez historię komputerów: co dalej?

Przeszliśmy długą drogę od starożytnych liczydel do zaawansowanych technologii, które dziś kształtują nasz świat. Mam nadzieję, że ta podróż przez historię komputerów dostarczyła Ci fascynujących spostrzeżeń i pomogła zrozumieć, jak doszliśmy do punktu, w którym się znajdujemy.

Najważniejsze lekcje z tej historii to:

- Nieustanny postęp: Historia komputerów to dowód na nieustający pęd ludzkości do innowacji i tworzenia coraz potężniejszych narzędzi.

- Kluczowe wynalazki: Od maszyny analitycznej Babbage'a, przez tranzystor, układ scalony, aż po mikroprocesor każdy z tych kroków był rewolucyjny.

- Ewolucja dostępności: Komputery przeszły drogę od skomplikowanych maszyn laboratoryjnych do urządzeń dostępnych dla każdego, co fundamentalnie zmieniło społeczeństwo.

- Przyszłość jest teraz: Sztuczna inteligencja i obliczenia kwantowe to kolejne etapy tej fascynującej podróży, które już teraz zaczynają kształtować naszą przyszłość.

Z mojego doświadczenia wynika, że zrozumienie historii technologii pozwala lepiej docenić jej obecny stan i świadomiej patrzeć w przyszłość. Obserwowanie, jak genialne wizje sprzed dekad stają się naszą codziennością, jest niezwykle inspirujące. Pamiętajmy, że każdy wielki wynalazek zaczynał od śmiałej idei i determinacji jego twórców. Dziś my jesteśmy świadkami i uczestnikami kolejnych technologicznych przełomów.

A jakie są Wasze wrażenia po tej podróży przez historię komputerów? Który wynalazek lub postać zrobiły na Was największe wrażenie i dlaczego? Podzielcie się swoimi przemyśleniami w komentarzach poniżej!